Со временем и скоростью света разобрались, пришло время искусственного интеллекта.

Сразу скажу, что я в этой теме не ездок, по этому буду рассуждать с дилетантской точки зрения.

Наверное все знают или слышали про «три закона робототехники», придуманные когда-то фантастом Азимовым для защиты человека от слишком умных роботов. До последнего времени было вполне очевидно, что так или иначе подобные ограничения нужно и можно запрограммировать в «мозг» робота. Однако, с развитием нейронных сетей, особенно с внедрением т.н. «глубинного обучения», стало понятно, что это будет непросто реализовать.

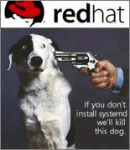

Дело в том, как мне представляется, что нельзя сделать обучаемую нейросеть с какой-то фиксированной частью, которая будет гарантированно подчиняться заранее заданным ограничениям. Можно, например, предобучить, но во-первых нет 100% гарантии, что сеть во всех возможных ситуациях поведет себя так, как мы того хотим (тем белее достаточно сложная сеть), во-вторых в процессе дальнейшего обучения фиксированные «знания» могут быть перекрыты приобретенными. Последние исследования Гугла (статья на ненавистном Хабре) вроде бы приближают нас к безусловному поведению ИИ, но по сути проблема остается та же - отсутствие 100% гарантии и перекрытие «инстинктов» приобретенными знаниями. Можно привести примеры из риал-лайф: отлично надрессированная собака в какой-то момент может запросто отгрызть яйца хозяину или случайному прохожему.

Что думает по этому поводу уважаемый коллективный СПВ? Возможно ли будет внедрить в ИИ три три закона робототехники с безусловным гарантированным их исполнением?