А есть ли такие чтобы при заданной схеме,лимитах и заранее выданных доп.инструкциях - или сразу делали бинарный блоб (структуру-структур-массивов C) или валились с ошибкой. Причём быстро ;-)

??

пока всё что находится в обозримом пространстве - они или делают свои динамические структуры, которые потом дополнительно надо мучительно обходить (с фичами lazy-parsing и прочее) или работают как sax-парсеры.

проверка схемы как-то сбоку прикручивается, хотя казалось-бы «зная схему можно резко ускорять парсинг».

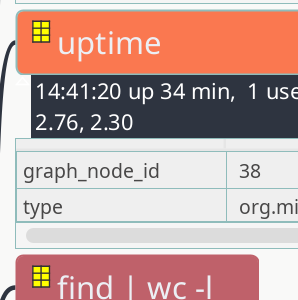

PS/ как-то получилось что потоки json начали измеряться в Mbps и парсинг становится больным местом.