Вечер добрый, комрады.

Помогите решить вопрос с настройками сети внутри KVM. Перерыл уже кучу профильных доков, своей думалки не хватает понять и устранить проблемы.

Дано: Хостовая машина, работает под управлением Ubuntu Server 16.04 Хост машина имеет один физический интерфейс смотрящий в локалку 10.10.80.150/24 и стек дополнительных IP (никак на момент установки не обозначенных 10.10.80.200-10.10.80.220). Во время установки был выбран KVM и автоматом подтянулись настройки моста.

Нужно: На хосте поднять виртуалку, которая бы работала на одном из IP стека *200-220, для определенности пусть будет *201.

После установки: Как выше написал, все настройки подтянулись автоматически, сеть везде есть, но стек нужных IP не задействован. Содержимое interfaces

auto enp1s0

iface enp1s0 inet static

address 10.10.80.150

netmask 255.255.255.0

gateway 10.10.80.1

dns-nameservers 10.10.80.1

enp1s0 Link encap:Ethernet HWaddr d0:50:99:95:21:25

inet addr:10.10.80.150 Bcast:10.10.80.255 Mask:255.255.255.0

inet6 addr: fe80::d250:99ff:fe95:2125/64 Scope:Link

UP BROADCAST RUNNING MULTICAST MTU:1500 Metric:1

RX packets:5704 errors:0 dropped:0 overruns:0 frame:0

TX packets:416 errors:0 dropped:0 overruns:0 carrier:0

collisions:0 txqueuelen:1000

RX bytes:806268 (806.2 KB) TX bytes:91228 (91.2 KB)

lo Link encap:Локальная петля (Loopback)

inet addr:127.0.0.1 Mask:255.0.0.0

inet6 addr: ::1/128 Scope:Host

UP LOOPBACK RUNNING MTU:65536 Metric:1

RX packets:160 errors:0 dropped:0 overruns:0 frame:0

TX packets:160 errors:0 dropped:0 overruns:0 carrier:0

collisions:0 txqueuelen:1

RX bytes:11840 (11.8 KB) TX bytes:11840 (11.8 KB)

virbr0 Link encap:Ethernet HWaddr 52:54:00:c2:e4:d1

inet addr:192.168.122.1 Bcast:192.168.122.255 Mask:255.255.255.0

UP BROADCAST RUNNING MULTICAST MTU:1500 Metric:1

RX packets:50 errors:0 dropped:0 overruns:0 frame:0

TX packets:34 errors:0 dropped:0 overruns:0 carrier:0

collisions:0 txqueuelen:1000

RX bytes:2824 (2.8 KB) TX bytes:2468 (2.4 KB)

virbr0-nic Link encap:Ethernet HWaddr 52:54:00:c2:e4:d1

BROADCAST MULTICAST MTU:1500 Metric:1

RX packets:0 errors:0 dropped:0 overruns:0 frame:0

TX packets:0 errors:0 dropped:0 overruns:0 carrier:0

collisions:0 txqueuelen:1000

RX bytes:0 (0.0 B) TX bytes:0 (0.0 B)

vnet0 Link encap:Ethernet HWaddr fe:54:00:dd:f0:72

inet6 addr: fe80::fc54:ff:fedd:f072/64 Scope:Link

UP BROADCAST RUNNING MULTICAST MTU:1500 Metric:1

RX packets:25 errors:0 dropped:0 overruns:0 frame:0

TX packets:1569 errors:0 dropped:0 overruns:0 carrier:0

collisions:0 txqueuelen:1000

RX bytes:1762 (1.7 KB) TX bytes:82392 (82.3 KB)

Собственно, вопрос, как правильно выполнить задачу? Для того чтобы задействовать нужные IP прописываю виртуальнй интерфейс

auto enp1s0:1

iface enp1s0:1 inet static

address 10.10.80.201

netmask 255.255.255.0

gateway 10.10.80.1

dns-nameservers 10.10.80.1

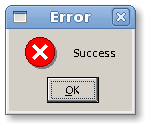

При перезапуске сети ловлю ошибку systemctl status networking.service

● networking.service - Raise network interfaces

Loaded: loaded (/lib/systemd/system/networking.service; enabled; vendor preset: enabled)

Drop-In: /run/systemd/generator/networking.service.d

└─50-insserv.conf-$network.conf

Active: failed (Result: exit-code) since Ср 2016-10-19 16:21:01 MSK; 43s ago

Docs: man:interfaces(5)

Process: 1639 ExecStop=/sbin/ifdown -a --read-environment (code=exited, status=0/SUCCESS)

Process: 1718 ExecStart=/sbin/ifup -a --read-environment (code=exited, status=1/FAILURE)

Process: 1710 ExecStartPre=/bin/sh -c [ "$CONFIGURE_INTERFACES" != "no" ] && [ -n "$(ifquery --read-environment --list --exclude=

Main PID: 1718 (code=exited, status=1/FAILURE)

окт 19 16:21:00 uto-d systemd[1]: Starting Raise network interfaces...

окт 19 16:21:01 uto-d ifup[1718]: RTNETLINK answers: File exists

окт 19 16:21:01 uto-d ifup[1718]: Failed to bring up enp1s0:1.

окт 19 16:21:01 uto-d systemd[1]: networking.service: Main process exited, code=exited, status=1/FAILURE

окт 19 16:21:01 uto-d systemd[1]: Failed to start Raise network interfaces.

окт 19 16:21:01 uto-d systemd[1]: networking.service: Unit entered failed state.

окт 19 16:21:01 uto-d systemd[1]: networking.service: Failed with result 'exit-code'.

Но при этом работает почти все )) нужный ip 10.10.80.201 пингуется в сети, если на хостовой машине настроить iptables, то веб-сервер, работающий на виртуалке прекрасно отвечает на 80 порту во вне, на хостовой машине сеть полноценно пашет, а вот исходящие запросы с виртуалки (например ping ya.ru) - лежат. Роуты верные на ней, адреса резолвятся, но пинг не уходит.

Вывод ifconfig -a с добавленным виртуальным интерфейсом идентичен на 100% с добавлением последнего

enp1s0:1 Link encap:Ethernet HWaddr d0:50:99:95:21:25

inet addr:10.10.80.201 Bcast:10.10.80.255 Mask:255.255.255.0

UP BROADCAST RUNNING MULTICAST MTU:1500 Metric:1

Помогите сделать «правильно». Спасибо.